Environnement

Le 29-09-2015, traduit par B.Chalumeau

Le 29-09-2015, traduit par B.ChalumeauAuteur : Docteur Timoty BALL.

Presque chaque modèle de prévision climatique, chaque projection, ou quelque soit le nom qu'ils lui donnent est erroné. Typiquement, les prévisions météorologiques au-delà de 72 heures se détériorent généralement à l'intérieur de leurs marges d'erreur. C'est ainsi que les prévisions de l'Office Météorologique britannique de l'été étaient fausses. Je ne mes souviens même plus du nombre de fois où ils se sont trompés. Ils ne font pas seulement des erreurs marginales. Sans arrêt, le temps qu'il fait est l'inverse de celui qu'ils avaient prévu.

Les prévisions climatiques à court, moyen et long terme sont fausse dans plus de 50% du temps de sorte qu'une prévision correcte n'est pas autre chose qu'un événement aléatoire. Les prévisions mondiales et régionales sont elles aussi le plus souvent fausses. S'il existait un modèle de prévisions climatiques climat capable de prévisions justes dans 60% des cas, tout le monde l'utiliserait. Comme il n'existe pas de modèle de prévision climatique assez précis, le GIEC s'arrange pour faire la moyenne des prévisions de ses modèles, comme si, en quelque sorte, les erreurs s'annuleraient mutuellement de sorte que la moyenne des prévisions soit représentative de la réalité.

Les prévisions climatiques à court terme ne valent pas mieux que celles de l'Almanach des anciens agriculteurs :

Les modèles climatiques et leurs prévisions ont été des échecs complets qui auraient conduit à l'arrêt de leur utilisation dans toute autre entreprise. Sauf, bien sûr, dans le cas d'un fiasco financé par le gouvernement. Les prévisions météorologiques quotidiennes ont commencé à s'améliorer à partir de la première guerre mondiale. Toutefois, même les prévisions climatiques à court terme ne semblent pas meilleures que celles de l'Almanach des anciens agriculteurs apparu en 1792, qui utilisait la lune, le soleil, et d'autres indicateurs astronomiques et terrestres.

Je suis fatigué de ces perpétuelles affirmations selon lesquelles les modèles climatiques peuvent fournir des prévisions correctes dans un système chaotique. La vérité c'est que les modèles climatiques ne fonctionnent pas et ne peuvent pas fonctionner correctement pour de nombreuses raisons, y compris les plus fondamentales : le manque de données, le manque de connaissance des processus physiques de base, l'incapacité des modèles climatiques à traduire fidèlement en formules mathématiques les phénomènes physiques comme la turbulence de l'air ainsi que l'insuffisance de capacité des ordinateurs.

Bob Tisdale a résumé ces problèmes dans son livre publié en 2013 « L'échec des modèles de prévisions climatiques ». Le moment est venu de cesser de gaspiller de l'argent et de perdre du temps dans ce domaine et d'affecter les chercheurs et les ordinateurs à des tâches plus importantes.

La seule chose qui pousse les gens à travailler sur les modèles de prévisions climatiques est le financement gouvernemental dans les bureaux de la météo ou à l'université. Sans ce financement, le GIEC n'existerait pas. Bien des gens impliqués dans la modélisation du climat n'ont aucune connaissance ni aucune formation en climatologie ou en science du climat. C'était des diplômés en programmation informatique à la recherche d'opportunités d'accès à de très hauts budgets et à de puissants ordinateurs.

Quand l'atmosphère et plus tard les océans étaient étudiés séparément, ça pouvait se concevoir. Mais maintenant qu'ils ont mis les deux ensembles on abouti au fiasco. Malheureusement cela fait supporter des charges énormes aux contribuables. Ces charges incluent non seulement les ordinateurs et les nombreuses heures de modélisation, mais aussi le coût pharaonique de l'application de résultats faux pour l'organisation mondiale de la gestion de l'énergie et pour la préservation de notre environnement.

Arrêtons ces simagrées et toute cette perte de temps et d'argent. Coupons tous les financements et plus personne ne dépensera l'argent des contribuables à travailler sur des modèles de prévisions climatiques.

Il m'est arrivé de prétendre qu'il pouvait y avoir quelque gain à s'amuser a concevoir des modèles de prévision climatiques en laboratoire avec un seul scientifique responsable de la précision, de la faisabilité et de l'applicabilité. Mais il est clair qu'ils n'atteignent pas leurs objectifs. Aussi, maintenant je me rends compte que cette proposition est mauvaise. Quand les résultats des modèles climatiques sont utilisés pour forger les politiques gouvernementales, il n'y a aucun gain. Par contre, il y a un coût phénoménal à la charge de la société en pure perte, correspondant aux frais de fonctionnement du GIEC, tout spécialement prévu pour empocher cet argent.

Le GIEC a toutefois un petit avantage. Il démontre la réalité des dysfonctionnements exposés dans les commentaires ci-dessus. Les modèles de prévisions climatiques sont manipulés dès leur sortie des laboratoires en dehors de toute rigueur scientifique dans les bureaux de la météorologie nationale ou à l'université, et deviennent ainsi les fondements des décisions politiques des hauts responsables des états à travers les rapports qu'ils reçoivent.

Un autre avantage des rapports du GIEC est qu'ils fournissent une liste détaillée des raisons pour lesquelles les modèles ne peuvent pas fonctionner et ne le pourront pas. Dommage que peu de gens les lisent ou cherchent à les comprendre. S'ils le faisaient, ils découvriraient les contraintes qui interdisent toute chance de succès. Juste un examen partiel le démontre.

Données :

Les gens du GIEC connaissaient les limites de données initiales dès le début, mais cela ne les empêcha pas de poursuivre la construction des modèles de prévisions climatiques.

En 1993, Stephen Schneider, un des promoteurs de l'hypothèse du réchauffement climatique d'origine anthropique et de l'utilisation de modèles passa du doute à la certitude quand il déclara :

Un rapport du 3 février, 1999 Conseil national de recherches des Etats-Unis d'Amérique déclare :

Ce à quoi Kevin Trenberth répondit :

Deux directeurs du CRU, Tom Wigley, and Phil Jones dirent :

70% de la surface du globe est couverte par des océans quasiment dépourvue de stations de relevés météorologiques.

Les pôles sont des zones essentielles dans la dynamique de la circulation atmosphérique et dans la création du climat et il n'y a encore quasiment aucune station météorologique dans 15 millions de km2 de l'océan Arctique ni dans les 14 millions de km2 de l'Antarctique. Environ 85% de la surface ne dispose d'aucune donnée météorologique. Le GIEC reconnaît ces limites en affirmant que les relevés d'une seule station sont représentatifs des conditions régnant dans un rayon de 1200 km. Est-ce une hypothèse valable? Je ne le pense pas.

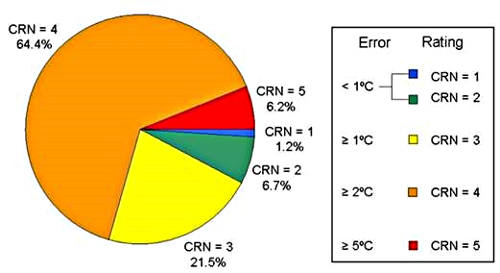

Mais ce n'est pas seulement un manque de données climatiques à la surface du globe. En fait il ne s'agit pas de données climatiques en surface, mais pour une gamme d'altitudes au dessus de la surface entre 1,25 et 2 mètres et comme les chercheurs depuis Geiger (Le Climat près du sol) on montré qu'elles sont nettement différentes des températures vraies mesurées par les quelques stations microclimatiques existantes. On peut prétendre que les stations météorologiques américaines sont les meilleures, mais l'étude produite par Anthony Watts montre que seulement 7,9% des stations météorologiques ont une précision de moins de 1%. (Figure 1). Pour mettre cela en perspective, dans le rapport du GIEC de 2001, Jones déclara qu'une augmentation de 0,6 °C sur 120 ans était au dessus des valeurs naturelles. Ceci souligne le fait que la plupart des températures enregistrées sont mesurées à 0,5°C près.

Les autres données de base telles que les précipitations, la pression barométrique, la vitesse et la direction du vent sont encore plus fausses que les données des températures. Par exemple, dans toute l'Afrique il y a seulement 1152 stations météorologiques qui ne représentent qu'un huitième de la densité minimale requise par l'Organisation Météorologique Mondiale (ONM). Comme je l'ao mentionné dans un précédent article, le manque de données pour toutes les phases du cycle de l'eau garantit l'échec des prévisions du GIEC.

Les modèles de prévisions météorologiques cherchent à simuler une atmosphère en trois dimensions, mais il n'y a pratiquement aucune mesure faite au dessus de la surface. Les producteurs de modèles pensent que nous sommes assez stupides pour croire l'argument selon lequel l'existence de plusieurs niveaux dans le modèle va résoudre le problème, mais c'est illusoire puisque nous n'avons pas les mesures correspondantes.

Les mécanismes principaux :

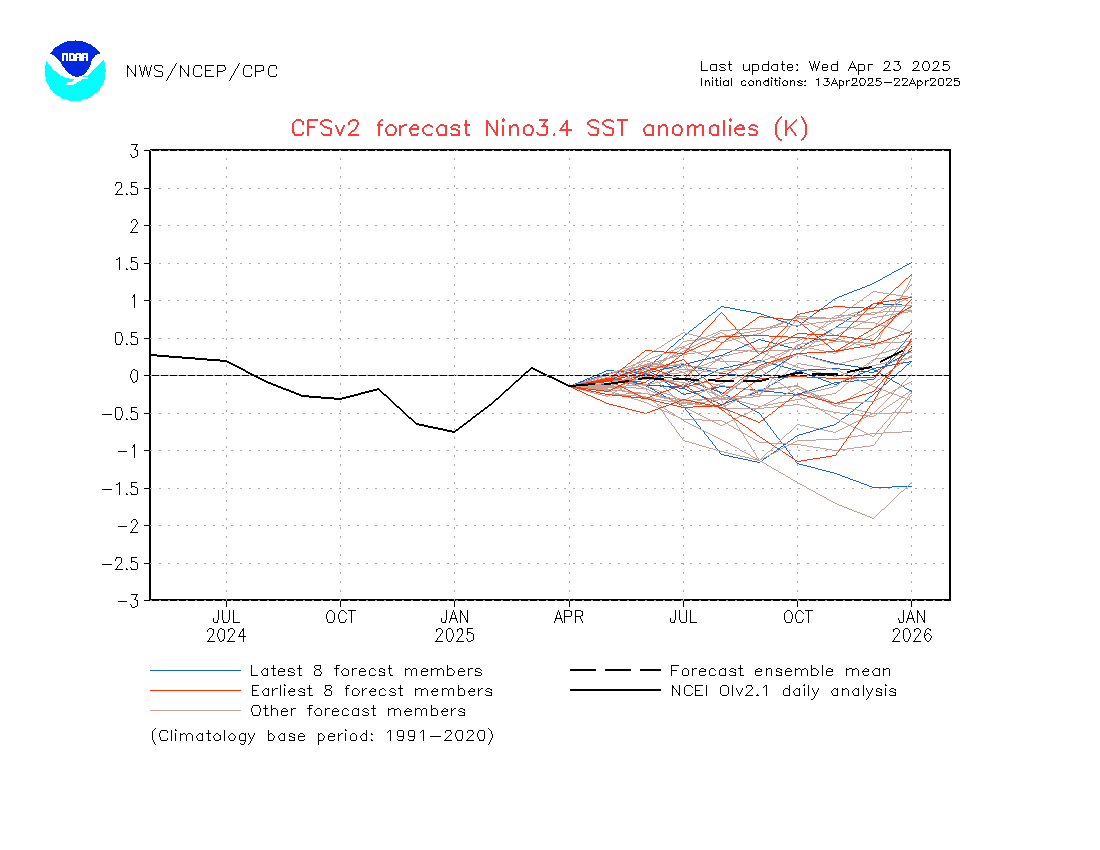

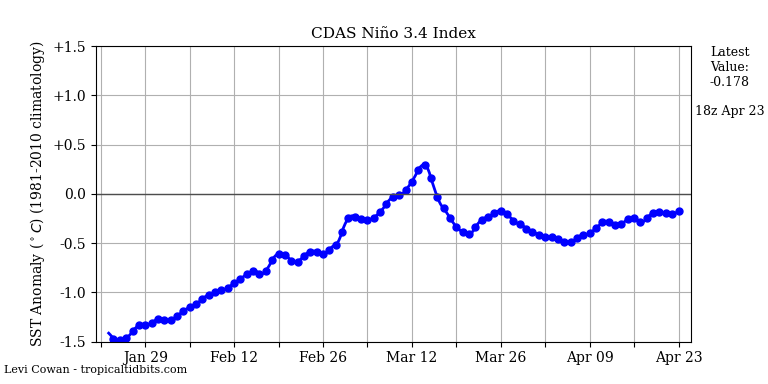

Pendant ma carrière de climatologue, plusieurs mécanismes météorologiques et climatiques ont été découvert ou mesurés, soi-disant avec une précision suffisante pour une application dans un modèle. Ceux-ci comprennent, El Nino / La Nina (ENSO), l'Oscillation Décennale du Pacifique (ODP), l'Oscillation Multidecennale Atlantique(OMA), l'oscillation antarctique (OAA), l'Oscillation Nord-Atlantique (ONA), la Dansgaard-Oeschger Oscillation (DO), l'Oscillation Madden-Julian (OMJ), le Dipôle de l'Océan Indien dipôle (DOI), entre autres.

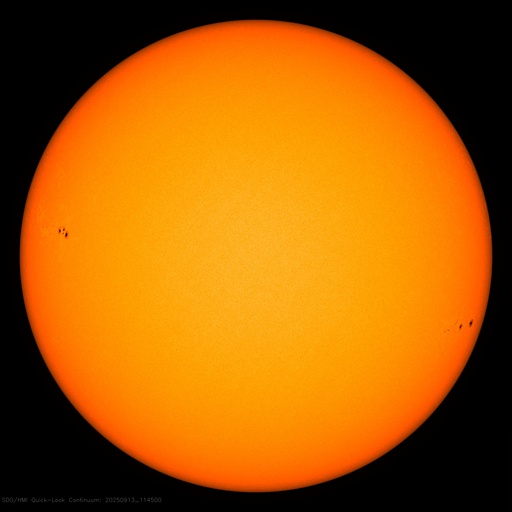

L'effet Milankovitch non inclus dans les modèles du GIEC :

Malgré cela, nous maîtrisons mal les mécanismes associés à la cellule de Hadley et à la Zone de Convergence Inter-Tropicale (ZCIT), qui sont représentatifs de l'ensemble des mécanismes du climat tropical. L'effet Milankovitch reste controversé et n'est pas pris en compte dans les modèles du GIEC. La théorie cosmique semble apporter une réponse à la relation entre les taches solaires, la température mondiale, et les précipitations, mais elle est ignorée elle aussi par le GIEC. Ils ne traitent pas avec le mécanisme de la mousson bien qu'ils mentionnent :

Il y a une connaissance très limitée des principales circulations océaniques en surface et dans les profondeurs. Il n'y a pratiquement aucune mesure des quantités de chaleur transférée ou de leurs évolutions dans le temps, y compris les mesures de chaleur géothermique.

Mécanismes physiques :

Le GIEC reconnaît que :

Cette prise de position suffit pour plaider en faveur de l'arrêt de cette perte de temps et d'argent. Elle se trouve confirmée par le second cas traité par Essex et McKitrick dans leur rapport « Pris par la tempète »

La recherche climatique est tout sauf une application systématique des théories classiques comme la mécanique des fluides par exemple, même si certains peuvent être tentés de le penser. Elle doit être classée en partie dans la catégorie des problèmes scientifiques « exotiques », parce que nous nous efforçons à chercher une structure scientifiquement crédible que personne ne peut voir ou n'a jamais vu, et qui peut même ne pas exister.

Capacité des ordinateurs :

Les concepteurs de modèles de prévisions climatiques prétendent que les ordinateurs s'améliorent sans cesse et qu'il leur faut toujours des ordinateurs plus gros et plus rapides. Ca ne les émeut pas et ils continuent à gaspiller l'argent. En 2012, la société Cray produisit le supercalculateur baptisé GEA (Figure 2). Il a une capacité de 1,1 petaflops. (FLOPS veut dire Opérations en virgules flottantes Par Seconde, et PETA signifie 1015 ou le milliard de millions d'opérations en virgule flottante par seconde). Jagadish Shukla dit que le défi est :

Quelle que soit la puissance de l'ordinateur, il est sans signification tant qu'on n'y introduit pas les valeurs exactes du modèle.

Mauvaises prévisions (prédictions, projections) :

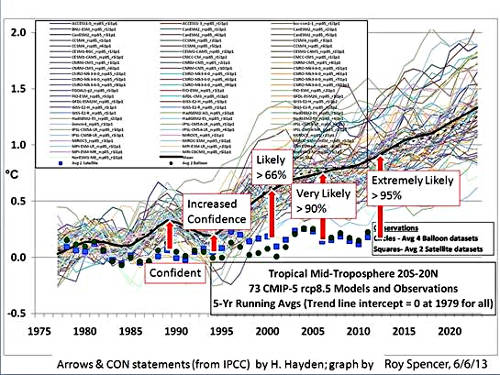

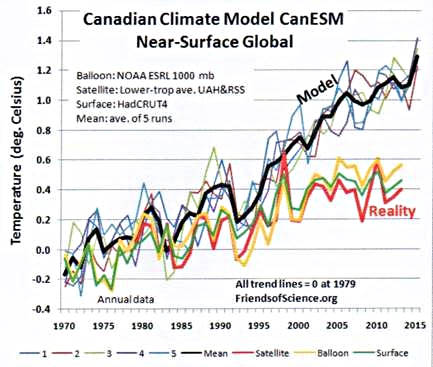

La figure 3 montre les prévisions fausses du GIEC. Ils les appellent des projections, mais le public croit que ce sont des prévisions. Quoi qu'il en soit, elles sont toujours fausses. Remarquez les étiquettes ajoutées au graphe de Hayden tirées du sommaire à l'attention des décideurs politiques. Comme la marge d'erreur augmente dans les données réelles du sommaire, le GIEC prétend que la précision s'améliore. Un des modèles informatiques utilisés pour les prévisions du GIEC appartient à Environnement Canada. Leurs prévisions sont les pires de tous ces résultats moyens utilisés par le GIEC (Figure 4).

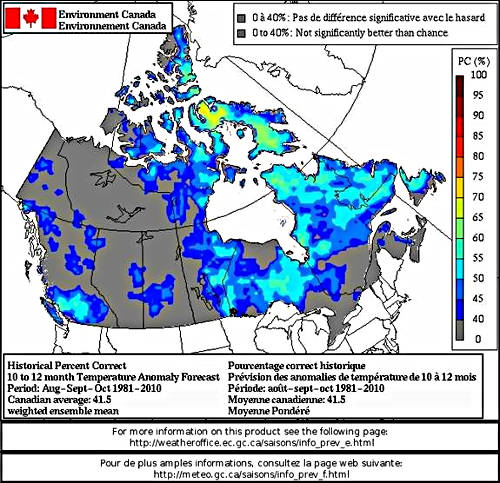

La catastrophe canadienne n'est pas surprenante comme l'indique leur prévision à un an l'indique. Ils font une prévision annuelle et fournissent une carte indiquant le pourcentage de précision par rapport à la moyenne pour la période 1981 à 2010 (figure 5).

Le pourcentage moyen de précision pour le Canada est indiqué en bas à gauche pour 41,5 pour cent. Voilà la meilleure valeur qu'ils peuvent atteindre après quelques trente années de développement des modèles de prévisions climatiques ! Pour les autres pays du globe, les résultats ne sont pas meilleurs.

Dans un rapport du « New Scientist », Tim Palmer, l'un des principaux modélisateur du climat au Centre européen de prévision météorologique à moyen terme de Reading England a dit:

Le coût du GIEC : "La somme actuellement dépenséedoit être bien supérieure à 100 milliards de dollars" :

Joanne Nova a fait la plupart des recherches sur le coût de la recherche climatique pour le gouvernement américain.

Il ne fait aucun doute que cette valeur a augmenté, et le total mondial est susceptible de doubler le montant des États-Unis que le commentateur ci-dessus a déclaré.

Ces coûts ne représentent que le coût de la modélisation informatique. Les coûts économiques et sociaux sont beaucoup plus élevés et pratiquement impossible à calculer. Comme l'explique Paul Driessen :

Il n'est pas étonnant que Larry Bell put dire :

S'il est impossible pour un organisme supposé sophistiqué comme le GAO américain pour déterminer les coûts, alors il n'y a aucun espoir pour obtenir un jour une évaluation pour l'ensemble de la planète. On peut donc penser sans trop se tromper que le coût direct se mesure enmilliers de milliards dedollars. Cela ne comprend pas les occasions perdues pour le développement et la vie continue dans la pauvreté. Tout cela à cause des résultats falsifiés de prédictions, de projections, ou autres noms, issues de modèles informatiques totalement défaillants

N'est-il pas temps d'arrêter la folie, qui, dans la science du climat, consiste à créer sans cesse, encore et encore des modèles informatiques qui ne fonctionnent pas et ne fonctionneront jamais ?

Pour ma part, je pense que oui !

Carrière :

1996 à maintenant - Environnementaliste, Conférencier, consultant, auteur, chroniqueur.

1988-1996 Professeur, Université de Winnipeg

1984-1988 professeur agrégé, Université de Winnipeg

De 1982 à 1984 Professeur adjoint, Université de Winnipeg

1977-1978 doyen intérimaire des étudiants

1972-1982 Maître de conférences, Département de géographie, Université de Winnipeg

De 1971 à 1972 Instructeur, Département de Géographie, Université de Winnipeg

Dr Ball est l'auteur de plus de 80 publications importantes.

Voir la liste ici:

http://drtimball.com/_files/dr-tim-ball-CV.pdf

WUWT

Suite...

Note aux lecteurs du site

Liens à connaîtres:

WUWT ( what's up with that )

Pensée unique pour les scientifiques

Pour apporter votre contribution ou suggérer un article, écrivez nous.

Version audio

Autres articles

Le GIEC : Nulle institution au monde n'a jamais fait si peu pour un prix aussi élevé.

Suite

La foudre peut déclencher des réactions nucléaires.

Suite

Avalanche d'alarmistes sur les dérèglements climatiques

Suite

GWPF: Nouvelle recherche solaire soulève des questions climatiques, déclenche des crises...

Suite

Réchauffement climatique en couleur

Suite

Age glaciaire pour 2050? Certainement (VO)

Suite

Le changement climatique est il dangereux? (VO)

Suite

Installer une "terreur du réchauffement climatique", pourquoi?

Suite

Vidéo (Vo)

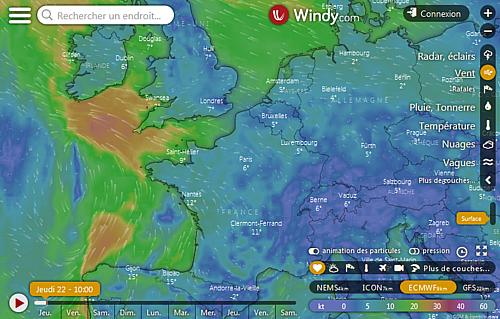

Météo

Météo windy.com par ville (mondiale)

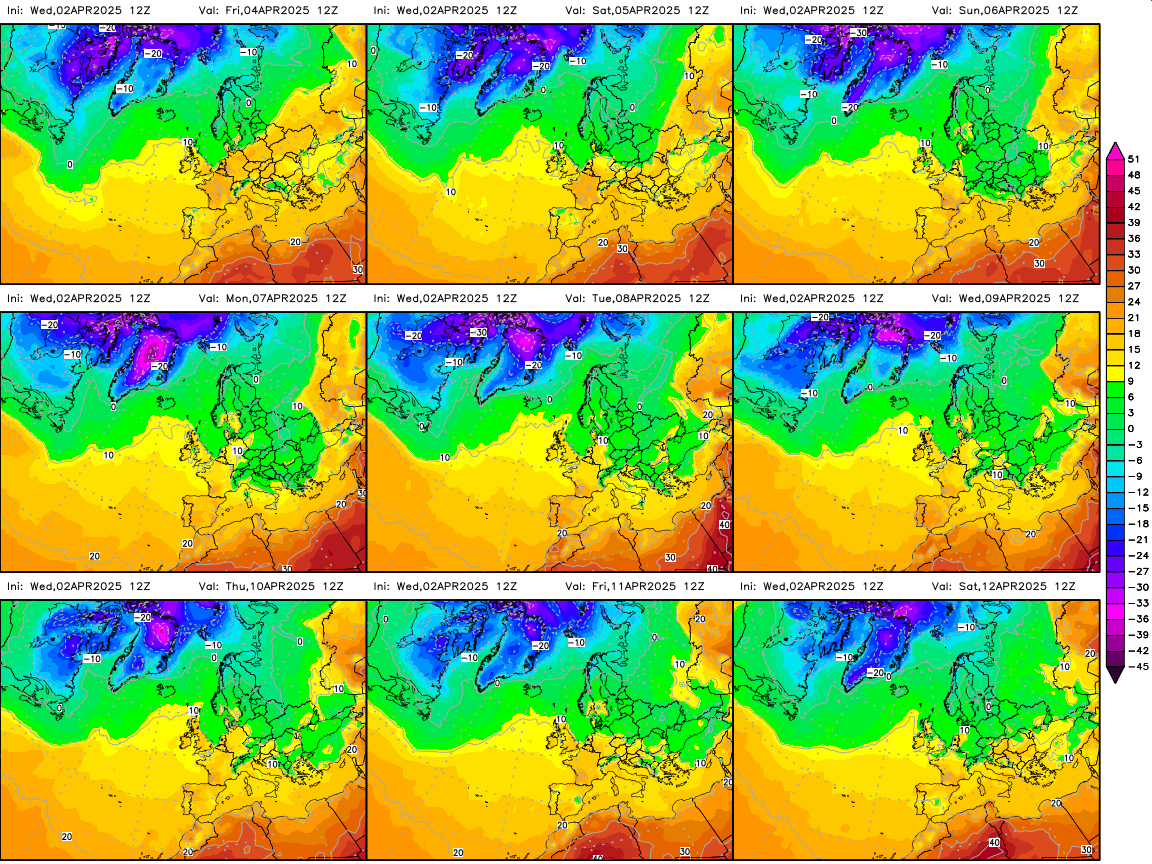

Météo windy.com par ville (mondiale) Masse d'air en UE pour les prochains 9 jours ©wetterzentrale.de

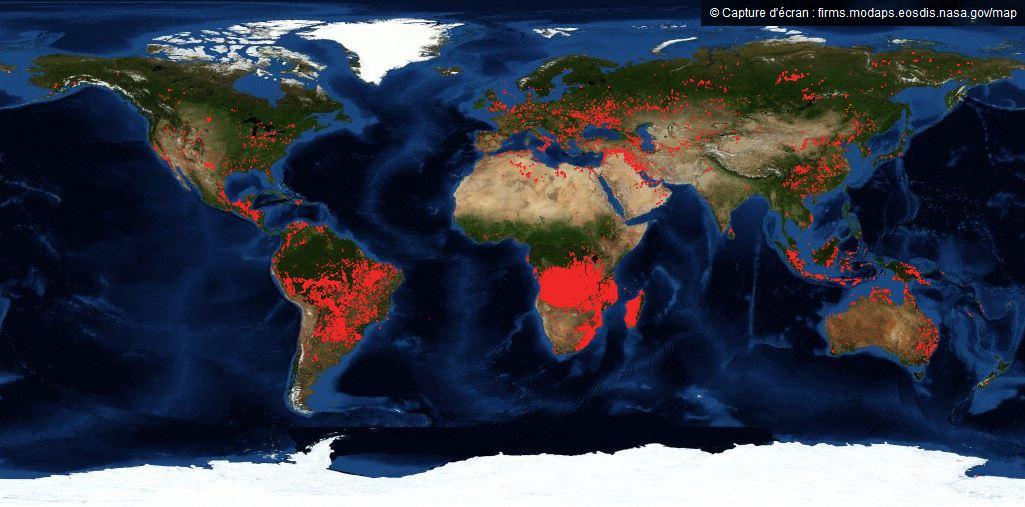

Masse d'air en UE pour les prochains 9 jours ©wetterzentrale.de Voir la MAP mondiale des incendies(NASA)

Voir la MAP mondiale des incendies(NASA)

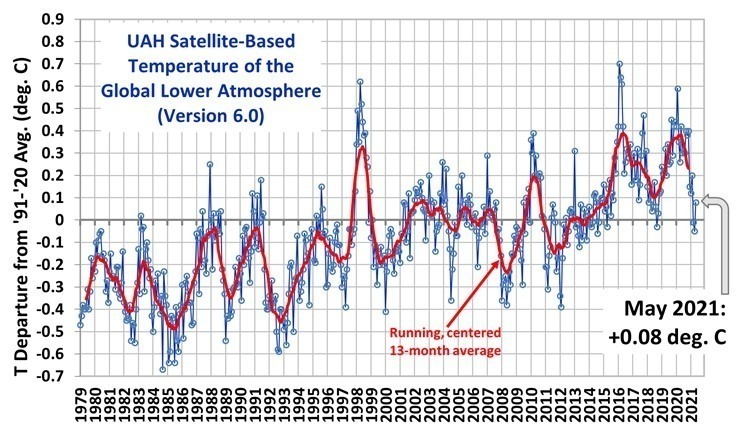

Température globale

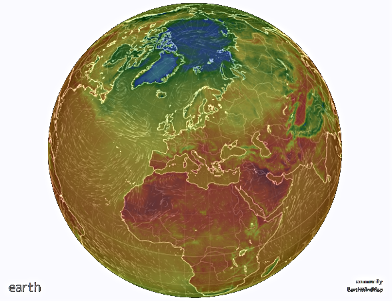

- Circulation atmosphérique -

Source:

earth.nullschool.net

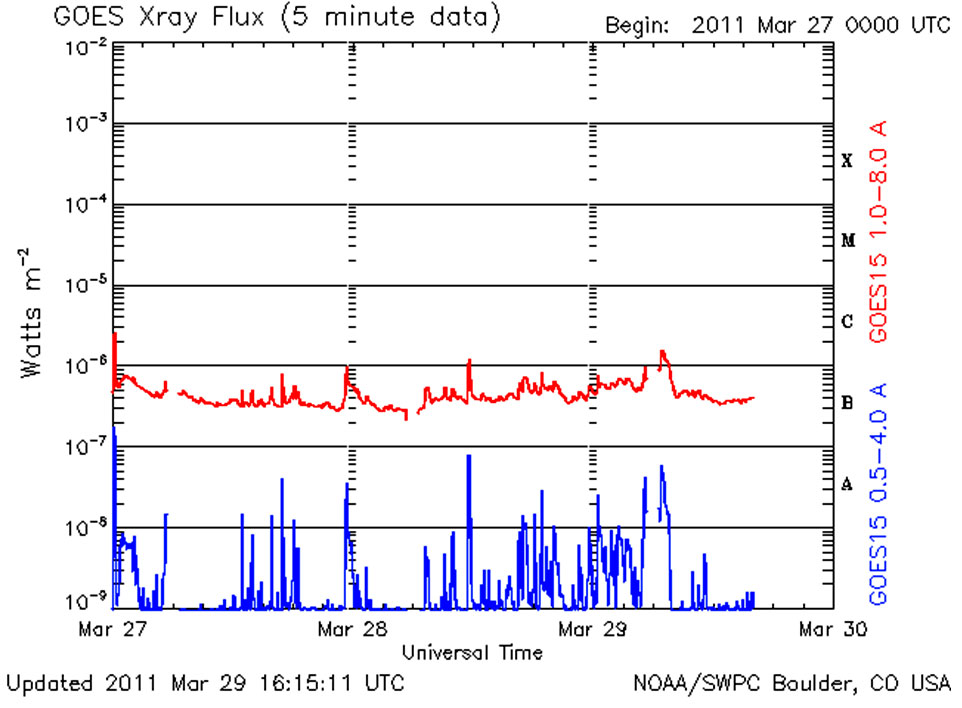

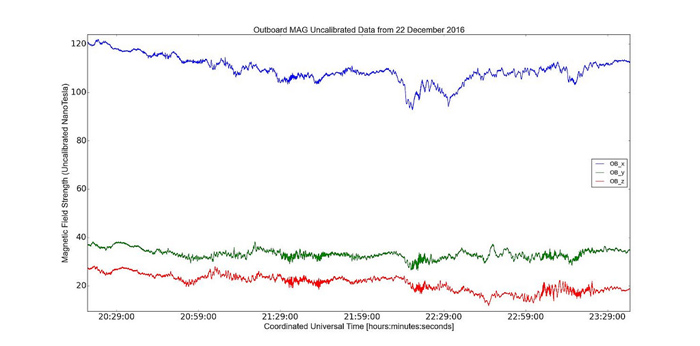

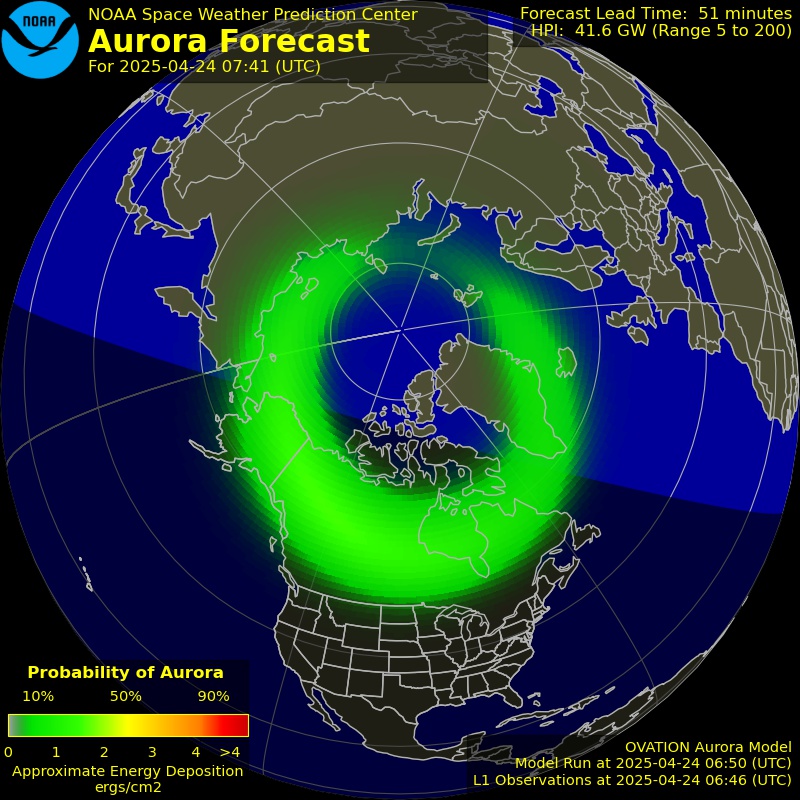

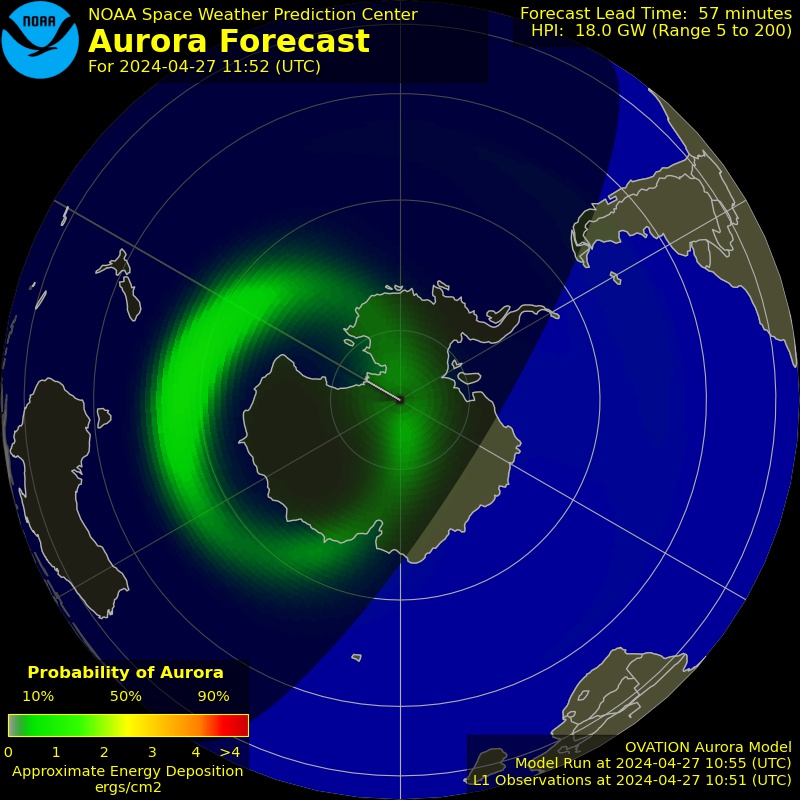

| Rayons X solaires: Champ géomagnétique: |

|

Source swpc.noaa.gov

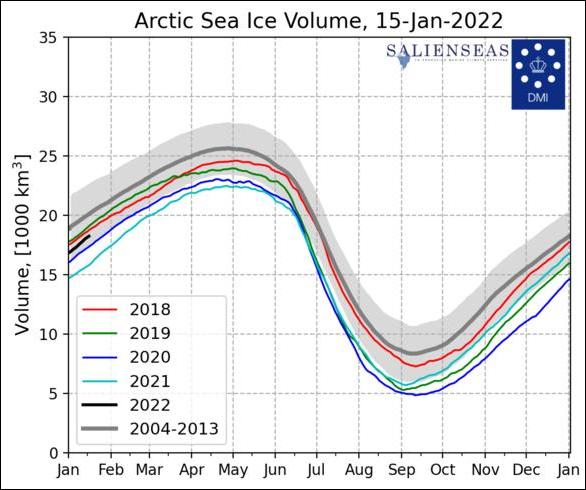

- Artic (volume et épaisseur) -

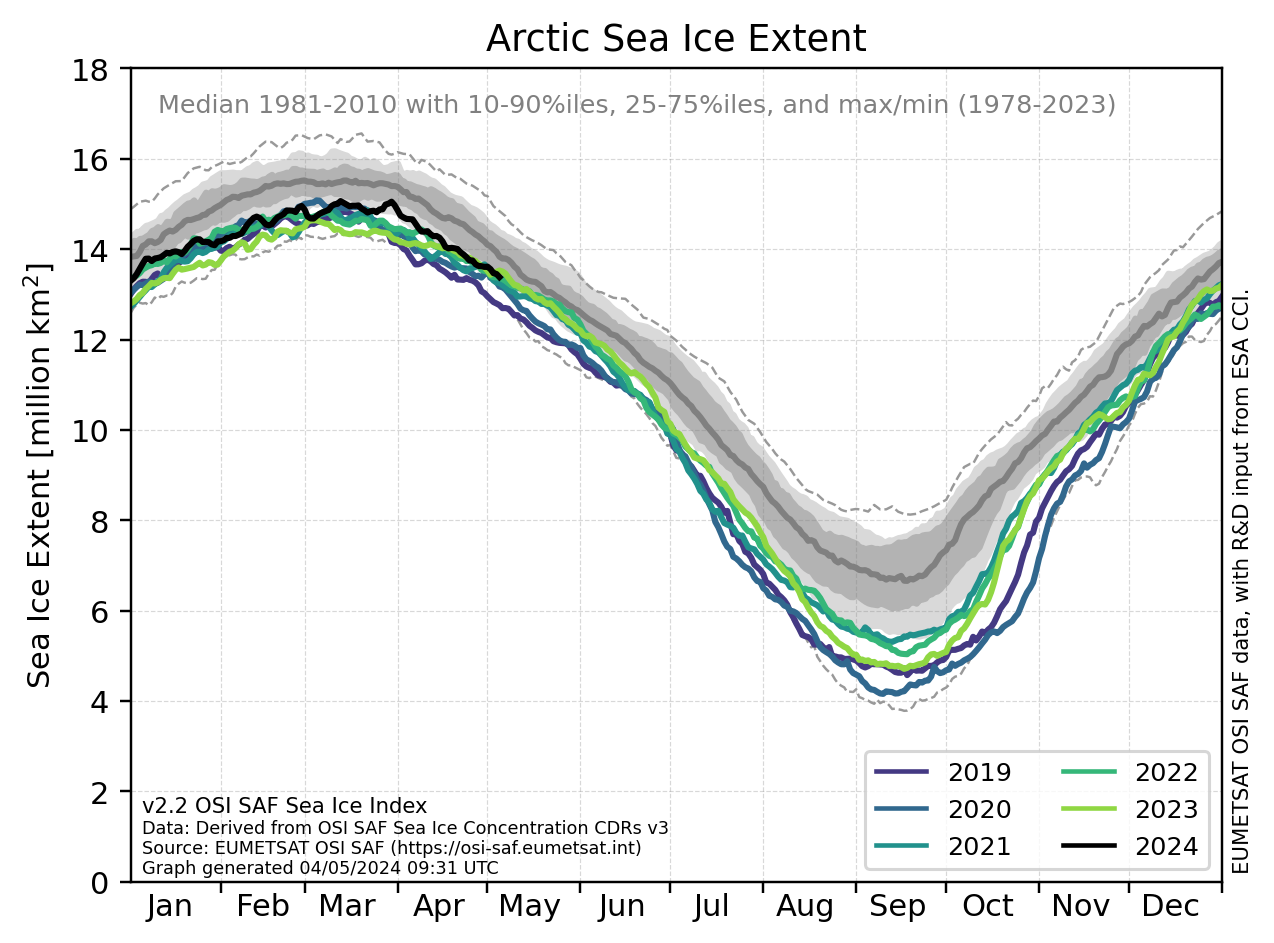

- Artic (Superficie) -

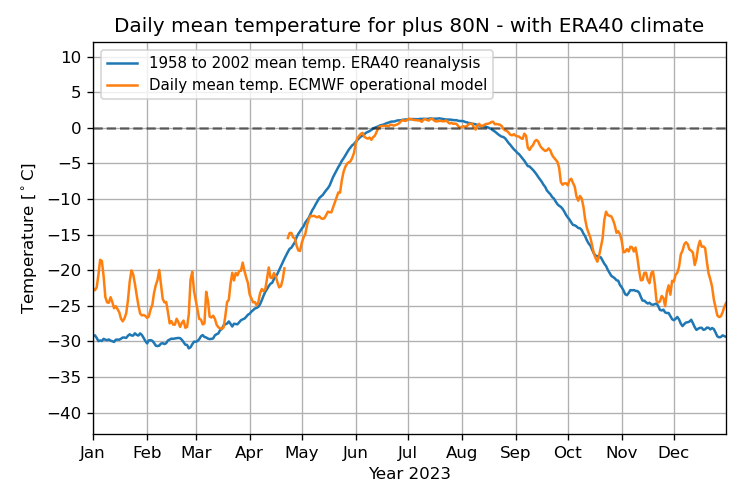

- T°(Kelvin) Arctique -

RSS Pôle Nord "Temperature Lower Troposphere" (TLT) – 1979 à aujourd'hui.

Source ocean.dmi.dk

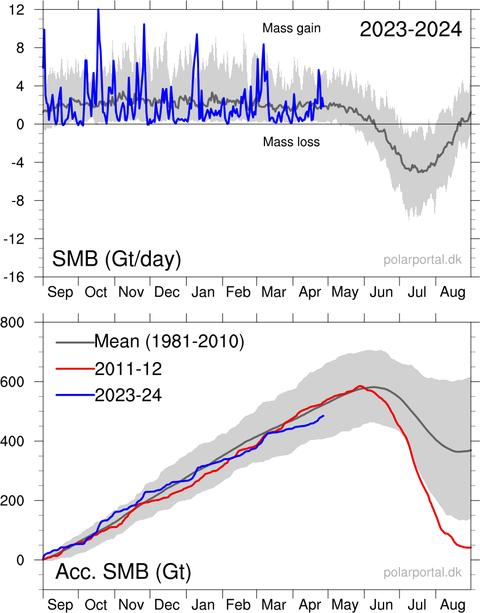

- Masse de glace au Groenland -

Gain/perte de la masse total et journalière

Source Polar Portal’s Greenland

- Carte interactive -

volcans actifs et séismes récents

Météo du froid (VO)

|

« Bienvenue ! La Direction de souverainete-france vous remercie de votre visite »

Site hébergé par SAS OVH - Code du site réalisé sous © et avec la collaboration de bénévoles sans outils web - pour navigateurs HTML5 IE, OPERA, Chrome et firefox (1024x768 minimum) La direction a fait les démarches nécessaire pour toutes les autorisations de publications d'images et des textes. Merci de bien vouloir signaler toutes mentions de copyright © omises. Le site et concepteurs ne peuvent être responsables ni du contenu ni des avis éventuellement exposés |

Mentions légales

Propriétaire du site Internet "souverainete-france":

Bernard Chalumeau - Membre fondateur

"Alliance pour la souveraineté de la France" (loi 1901)

BP 20 - 77411 Claye Souilly

Important: Les droits de propriété intellectuelle afférent aux sites "souverainete-france" appartiennent à Monsieur Bernard Chalumeau.

Toute utilisation, reproduction, diffusion, commercialisation, modification de toute ou partie du site, sans l’autorisation de l'Alliance pour la souveraineté de la France est prohibée et pourra entraînée des actions et poursuites judiciaires telles que notamment prévues par le code de la propriété intellectuelle et/ou le code civil.

Objet statutaire de l'Alliance pour la souveraineté de la France (J.O du 31/01/1998) : L’ALLIANCE POUR LA SOUVERAINETE DE LA FRANCE est un cercle de réflexion politique, économique, culturelle et sociale.

Elle a notamment pour but de réunir et de coordonner l’action et la réflexion de ses membres, de contribuer au débat public par des études et des analyses, particulièrement par l’édition et/ou la réunion de textes de référence de ceux qui tiennent à l’indépendance nationale (législative, politique, institutionnelle, administrative, territoriale, militaire, diplomatique, énergétique, fiscale, patrimoniale, économique, monétaire, bancaire, industrielle, commerciale, agricole, écologique, numérique, culturelle, linguistique, sociale, et autres), au respect de la souveraineté de la France qui est « une, indivisible, inaliénable et imprescriptible » et du principe de la compétence de la compétence.

L’ALLIANCE POUR LA SOUVERAINETE DE LA FRANCE propose des alternatives à toute démarche, à tout traité, à tout acte, projeté ou existant, qui contreviendrait à ces principes au sens des membres de l’association, ou à ceux de la Constitution de la Vème République approuvée par référendum, norme suprême du peuple français, étant entendu que tout texte adopté par le biais d’un référendum ne peut être modifié ou abrogé que par référendum.

L’ALLIANCE POUR LA SOUVERAINETE DE LA FRANCE a vocation à conduire sa réflexion et son action tant au plan national qu’international.

Elle promeut l’unité de la Nation française, de son identité et de sa culture, et la pérennité des français en tant que peuple, par le respect de la protection universelle de tout humain.

Elle diffuse les résultats de ses réflexions à la population ainsi qu’aux décideurs, y compris politiques, par tous moyens de communication usuels, sans restriction, et notamment par le biais de son site Internet.

Elle agit par ses propres moyens et par ceux des associations adhérentes.

Note concernant les cookies:

Ce site utilise les cookies pour son bon fonctionnement. Pour en savoir plus

Toute données enregistrées lors d'une adhésion dont @ip sont traitées en toute confidentialité avec droit de consultation/rectification par l'intéressé